Es gibt KI-Benchmarks, die beeindrucken. Und es gibt Benchmarks, die irritieren. ARC-AGI-3 gehört für mich klar zur zweiten Kategorie – im besten Sinne.

Denn während viele aktuelle Benchmarks vor allem zeigen, ob ein Modell eine Aufgabe richtig beantwortet, schaut ARC-AGI-3 an einer viel unangenehmeren Stelle hin: Kann ein KI-System in einer völlig neuen Umgebung selbst herausfinden, was überhaupt zu tun ist?

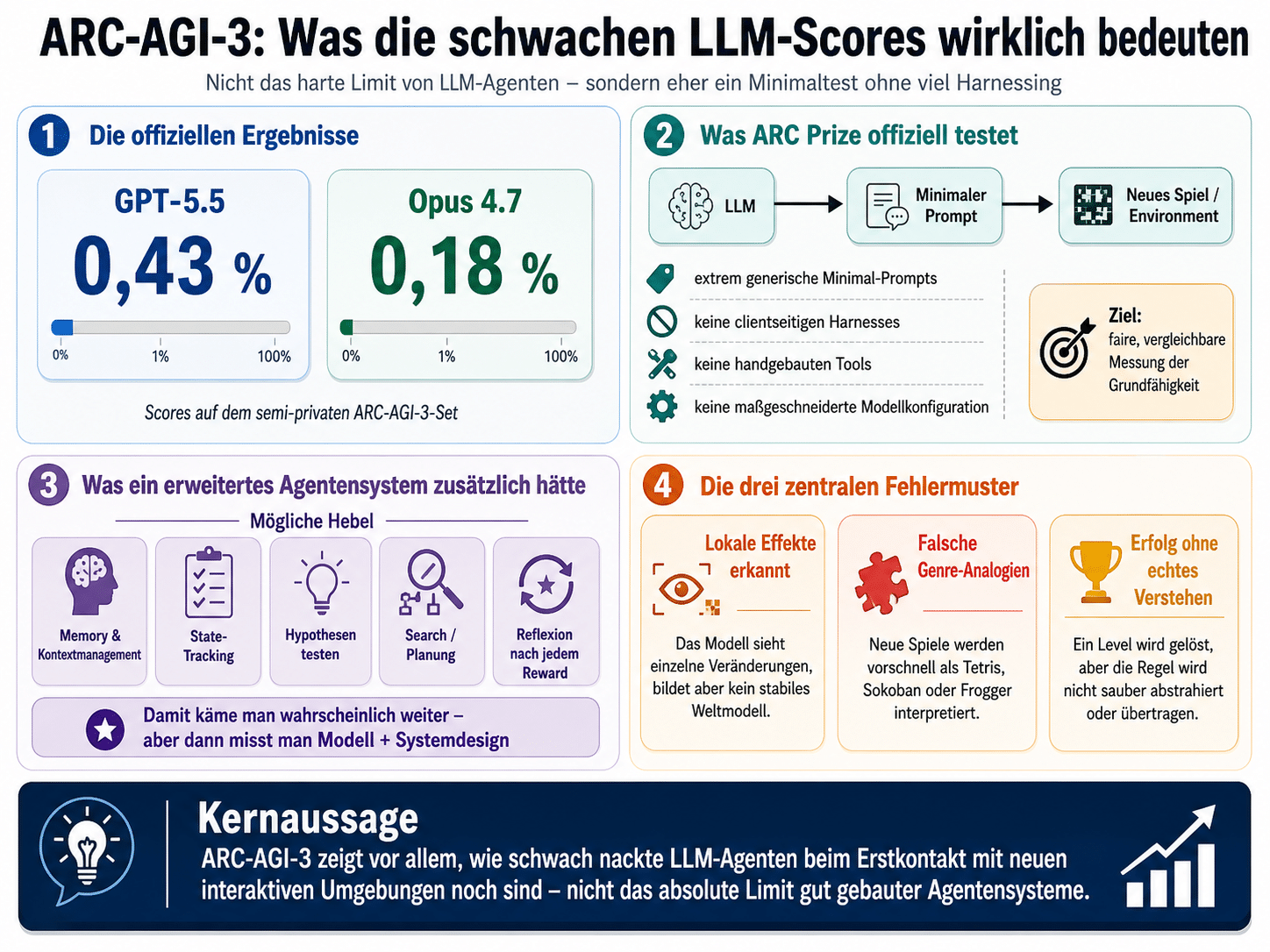

Genau deshalb fand ich die aktuelle Analyse von ARC Prize zu GPT-5.5 und Anthropic Opus 4.7 so spannend. Die offiziellen Scores wirken auf den ersten Blick fast absurd niedrig: GPT-5.5 erreicht auf dem semi-privaten ARC-AGI-3-Set 0,43 Prozent, Opus 4.7 kommt auf 0,18 Prozent. Grundlage der qualitativen Analyse waren 160 Replays und Reasoning-Traces aus öffentlichen Runs, also nicht nur Endergebnisse, sondern tatsächliche Spielverläufe samt Modellbegründungen.

Das klingt nach einem vernichtenden Urteil über Frontier-Modelle. Aber ich glaube, genau hier lohnt sich ein zweiter Blick.

Denn die eigentliche Frage ist nicht nur: Wie schlecht schneiden LLMs bei ARC-AGI-3 ab?

Die interessantere Frage für mich lautet: Wie hart hat ARC Prize wirklich versucht, mit diesen LLMs möglichst weit zu kommen?

Meine Antwort nach der Lektüre: hart in der Analyse, aber bewusst nicht hart in der Optimierung.

Was ARC-AGI-3 eigentlich testet

ARC-AGI-3 besteht aus 135 neuartigen, von Menschen gestalteten interaktiven Umgebungen. Die Testperson – egal ob Mensch oder KI – bekommt keine Anleitung, sondern muss durch Ausprobieren herausfinden, welche Aktionen welche Effekte haben, welche Ziele gelten und welche Regeln von Level zu Level übertragen werden können.

Das ist ein wichtiger Unterschied zu klassischen Benchmarks. Hier geht es nicht darum, eine Frage zu beantworten, Code zu schreiben oder ein bekanntes Rätselmuster wiederzuerkennen. Es geht um Exploration, Hypothesenbildung, Korrektur falscher Annahmen, Planung und Lernen aus spärlichem Feedback. ARC Prize beschreibt genau diese Anforderungen: unbekannte Interfaces erkunden, Regeln aus wenig Feedback ableiten, Hypothesen testen, Irrtümer revidieren und Gelerntes auf spätere Level übertragen.

Das ist ziemlich nah an dem, was wir von echten Agenten erwarten würden. Ein Agent, der in einem Unternehmen mit internen Tools, Dashboards, Formularen, APIs und Workflows arbeiten soll, bekommt in der Realität auch nicht immer eine perfekte Bedienungsanleitung. Er muss erkennen, was wichtig ist, welche Aktionen möglich sind und welche Effekte sie haben.

Genau deshalb ist ARC-AGI-3 aus meiner Sicht so interessant: Es testet nicht nur Wissen, sondern adaptive Handlungsfähigkeit.

Die drei Fehlermuster: Sehen ist nicht Verstehen

Besonders spannend ist, dass ARC Prize nicht nur Scores veröffentlicht, sondern auch die Fehler analysiert. Dabei werden drei wiederkehrende Muster beschrieben:

Erstens: Die Modelle erkennen lokale Effekte, bauen daraus aber kein belastbares Weltmodell. Sie sehen beispielsweise, dass eine Aktion ein Objekt dreht, verstehen aber nicht, welche globale Regel dahintersteht und wie diese Regel strategisch genutzt werden müsste.

Zweitens: Die Modelle interpretieren neue Umgebungen zu stark durch bekannte Spielmuster. ARC Prize nennt unter anderem Analogien zu Tetris, Frogger, Sokoban, Breakout, Pong und anderen Spielen. Das Problem ist nicht, dass Analogien grundsätzlich schlecht wären. Das Problem ist, dass eine oberflächliche Ähnlichkeit zu einer falschen vollständigen Spieltheorie wird.

Drittens: Selbst wenn ein Level gelöst wird, bedeutet das nicht, dass das Modell das Spiel verstanden hat. ARC Prize beschreibt Beispiele, in denen ein Modell durch Zufall oder durch eine unvollständige Theorie ein erstes Level schafft, diese falsche Theorie dann aber in Level 2 fortschreibt und daran scheitert.

Das finde ich besonders aufschlussreich. Denn genau solche Fehler sehen wir auch bei LLM-Agenten außerhalb von Spielen: Sie machen etwas scheinbar richtig, aber aus dem falschen Grund. Und sobald sich der Kontext leicht verändert, bricht die Strategie zusammen.

Wie hart wurde es wirklich versucht?

Jetzt kommt der entscheidende Punkt.

Wenn man die offiziellen ARC-AGI-3-Scores liest, könnte man meinen: GPT-5.5 und Opus 4.7 können das schlicht nicht. Aber das wäre mir zu einfach.

Denn ARC Prize sagt sehr klar, dass die offiziellen Tests gerade nicht darauf ausgelegt sind, mit maximalem Prompt Engineering, spezialisierten Tools oder einem ausgefeilten Agenten-Harness den bestmöglichen Score herauszuholen.

In der offiziellen Testing Policy heißt es sinngemäß: Um faire Vergleiche zu ermöglichen und falsche AGI-Signale zu vermeiden, nutzt ARC Prize extrem generische minimale LLM-Testprompts, keine clientseitigen Harnesses, keine handgebauten Tools und keine individuell zugeschnittene Modellkonfiguration.

Auch der technische Report ist hier sehr deutlich. Für die offiziellen ARC-AGI-3-Scores sollen Systeme bewertet werden, die nicht speziell für ARC-AGI-3 vorbereitet wurden und hinter einer allgemeinen API laufen. Der offizielle Leaderboard-Score nutzt daher kein Harness. Die Modelle bekommen keine externen Tools, abgesehen von möglichen internen Tools, die hinter der Modell-API verborgen sind. Der Systemprompt ist minimal: „Du spielst ein Spiel. Dein Ziel ist zu gewinnen. Antworte mit der exakten Aktion …“

Mit anderen Worten: Die offiziellen Scores messen nicht, was ein Team aus Agenten-Entwickler:innen mit GPT-5.5 oder Opus 4.7 bauen könnte. Sie messen eher, was passiert, wenn man ein Frontier-Modell fast nackt in eine neue interaktive Umgebung wirft.

Das ist kein Bug des Benchmarks. Das ist die Designentscheidung.

Warum diese Designentscheidung sinnvoll ist

Ich halte diese Entscheidung für nachvollziehbar – auch wenn sie die Interpretation erschwert.

ARC Prize will nicht messen, wie viel menschliche Intelligenz in ein ARC-spezifisches System hineinentwickelt wurde. Sie wollen wissen, ob ein allgemeines KI-System beim Erstkontakt mit einer unbekannten Aufgabe selbstständig generalisieren kann. Der technische Report unterscheidet ausdrücklich zwischen task-spezifischem Overfitting, also Optimierung auf bekannte öffentliche Umgebungen, und domain-spezifischem Overfitting, also Strategien, die speziell auf ARC-AGI-3 als Domäne zugeschnitten sind.

Das ist wichtig. Denn sonst würden wir am Ende vor allem messen, wer den besten ARC-AGI-3-Solver gebaut hat – nicht, welches Modell allgemein intelligenter oder adaptiver ist.

Und genau hier entsteht die Spannung: Aus Sicht eines Benchmarks ist ein minimalistisches Setup sinnvoll. Aus Sicht praktischer Agentenentwicklung ist es aber fast künstlich schwach.

Denn in der Praxis würden wir ein LLM ja gerade nicht allein lassen.

Was ein gutes Harness verändern würde

Ein Harness ist vereinfacht gesagt das technische Gerüst um ein Modell herum. Es entscheidet, wie Beobachtungen aufbereitet werden, wie Erinnerungen gespeichert werden, welche Tools verfügbar sind, wie frühere Aktionen analysiert werden, wie Hypothesen verwaltet werden und wie Pläne überprüft werden.

Und genau da liegt meiner Meinung nach der Hebel.

Ein besseres Harness könnte etwa:

- visuelle Zustandsänderungen automatisch erkennen,

- Objekte über Frames hinweg tracken,

- Aktion-Effekt-Tabellen führen,

- Hypothesen explizit speichern und priorisieren,

- Experimente planen, statt zufällig zu klicken,

- erfolgreiche Level nachträglich kausal erklären,

- falsche Genre-Analogien unterdrücken,

- frühere Zustände gezielt abrufen,

- und nach jedem Reward prüfen, warum der Reward zustande kam.

Das ist nicht nur Prompting. Das ist Context Engineering im eigentlichen Sinne: Wahrnehmung, Gedächtnis, Tool-Nutzung, Kompression, Planung und Selbstkorrektur werden so gestaltet, dass das Modell überhaupt eine Chance hat, über viele Schritte hinweg konsistent zu handeln.

Und ARC Prize liefert selbst Hinweise darauf, dass Harnesses sehr wohl viel bringen können.

Im technischen Report wird beschrieben, dass Opus 4.6 in einer TR87-Variante ohne Harness 0,0 Prozent erreichte, mit dem Duke-Harness aber 97,1 Prozent. In einer anderen Umgebung, BP35, blieb dasselbe Modell allerdings sowohl mit als auch ohne Harness bei 0,0 Prozent. ARC Prize interpretiert das als Beleg dafür, dass Wahrnehmung und API-Format nicht grundsätzlich der limitierende Faktor sind, spezifisch gebaute Harnesses aber oft schlecht auf neue Umgebungen generalisieren.

Genau das ist der springende Punkt: Ein Harness kann massiv helfen. Aber sobald es zu stark auf bekannte Aufgaben oder eine bestimmte Benchmark-Logik zugeschnitten ist, misst der Score nicht mehr nur Modellfähigkeit, sondern auch die Ingenieursleistung im Gerüst.

Die wirklich spannende Frage: generisches Harness statt ARC-Tricks

Für mich ist deshalb nicht die Frage, ob man ARC-AGI-3 mit genug Tricks besser lösen kann. Natürlich kann man das.

Die spannende Frage lautet: Wie weit kommt ein vorab eingefrorenes, wirklich generisches Agenten-Harness auf ungesehenen ARC-AGI-3-Umgebungen?

Also kein System, das ARC-spezifische Strategien einprogrammiert bekommt. Keine manuell optimierten Prompts für einzelne Spiele. Kein Zugriff auf öffentliche Lösungen. Sondern ein allgemeines Agenten-Gerüst mit Werkzeugen, die auch in anderen Domänen sinnvoll wären:

Frame-Differencing. State-Tracking. Hypothesenmanagement. Kurz- und Langzeitgedächtnis. Explorationsplanung. Tool-Nutzung. Selbstkritik. Kausale Tests.

Das wäre aus meiner Sicht der eigentlich relevante nächste Schritt.

Interessanterweise erkennt ARC Prize den Wert solcher Harness-Forschung durchaus an. Der technische Report führt eine Community-Leaderboard-Kategorie für harness-getriebene Ergebnisse ein, warnt aber zugleich davor, solche Scores direkt als AGI-Fortschritt zu interpretieren.

Auch die frühen Experimente zeigen, wohin die Reise gehen könnte. In der Preview Agent Competition erreichte StochasticGoose von Tufa Labs 12,58 Prozent mit einem CNN- und Reinforcement-Learning-Ansatz zur Vorhersage frame-verändernder Aktionen; Blind Squirrel kam mit einem gerichteten State-Graphen auf 6,71 Prozent. Beide erfolgreichen Ansätze nutzten im Kern informierte Suche im Aktionsraum.

Dazu kommen agentische Harness-Ansätze wie das Duke-System, das einem Large Reasoning Model erlaubt, Python-Code auszuführen, um gezielt frühere Zustände aus der Aktionshistorie abzurufen und zu transformieren. In den öffentlichen Umgebungen löste dieser Ansatz alle drei Aufgaben mit menschenähnlicher Aktionseffizienz. Symbolica AIs Arcgentica wiederum arbeitet mit einer Orchestrator-Subagenten-Architektur und komprimierten Textzusammenfassungen, um Kontextwachstum zu begrenzen und trotzdem einen übergeordneten Plan zu halten.

Das sind für mich keine Nebendetails. Das ist der eigentliche Forschungsraum.

Prompting hilft – aber es reicht wahrscheinlich nicht

Natürlich könnte man auch mit besseren Prompts mehr herausholen.

Man könnte das Modell anweisen, Beobachtung, Hypothese und Plan strikt zu trennen. Man könnte verlangen, dass jede Aktion als Experiment verstanden wird. Man könnte falsche Genre-Analogien aktiv sanktionieren: „Nenne keine bekannten Spiele, solange keine kausale Evidenz dafür vorliegt.“ Man könnte nach jedem Erfolg eine Reflexionsphase erzwingen: „Welche Regel erklärt den Erfolg minimal und generalisiert auf das nächste Level?“

Das würde vermutlich helfen.

Aber ich glaube nicht, dass Prompting allein das Kernproblem löst. Denn viele Fehler entstehen nicht nur durch falsche Instruktion, sondern durch fehlende externe Struktur. LLMs sind stark darin, Muster sprachlich zu formulieren. Aber in langen interaktiven Umgebungen brauchen sie ein Gedächtnis, eine saubere Zustandsrepräsentation und eine robuste Methode, um Hypothesen gegen Beobachtungen zu testen.

Auch die ARC-Dokumentation zeigt übrigens sehr schön, wo die Grenze liegt. Es gibt dort ein „GuidedLLM“-Template mit expliziten spiel-spezifischen Regeln und Strategien im Prompt. Die Dokumentation weist aber selbst darauf hin, dass dieses Template zu Bildungszwecken gedacht ist und nicht auf andere Spiele generalisiert.

Das ist genau der Unterschied zwischen cleverem Prompt und allgemeiner Intelligenz.

Meine Einordnung

Die niedrigen Scores von GPT-5.5 und Opus 4.7 bei ARC-AGI-3 beweisen nicht, dass LLM-basierte Agentensysteme grundsätzlich chancenlos sind.

Sie beweisen eher etwas Präziseres und Spannenderes:

Nackte Frontier-LLMs sind beim Erstkontakt mit neuartigen, interaktiven, nichtsprachlich erklärten Umgebungen noch extrem schwach.

Das ist eine wichtige Aussage. Aber sie ist nicht identisch mit: „Mit Tools, Memory, Search, Perception und gutem Harness geht da nicht viel mehr.“

Im Gegenteil: Die bisher veröffentlichten Harness-Ergebnisse legen nahe, dass sehr viel mehr möglich ist – allerdings oft auf Kosten der Generalität. Ein System kann auf bekannten oder ähnlichen Umgebungen stark werden, ohne wirklich allgemein adaptiv zu sein.

Für mich liegt genau hier die Grenze zwischen Benchmarking und Produktentwicklung.

Ein Benchmark wie ARC-AGI-3 muss überfitting-resistent sein. Er muss verhindern, dass wir menschliche Vorarbeit im Harness fälschlich als Modellintelligenz feiern.

Ein praktisches Agentensystem hingegen sollte natürlich jede sinnvolle Hilfe nutzen. In realen Anwendungen interessiert mich selten, ob die Intelligenz „pur“ im Modell sitzt oder teilweise im Workflow, im Tooling, in der Memory-Schicht oder in der Systemarchitektur. Mich interessiert, ob das Gesamtsystem zuverlässig, nachvollziehbar und robust handelt.

Aber für die Forschung ist diese Unterscheidung entscheidend.

Fazit: Nicht das Ende der LLMs, sondern das Ende der Illusion vom nackten Agenten

ARC-AGI-3 zeigt für mich nicht, dass moderne LLMs nutzlos sind. Es zeigt, dass wir sie nicht mit echter autonomer Anpassungsfähigkeit verwechseln sollten.

Ein Modell, das hervorragend schreibt, codet, erklärt und bekannte Muster kombiniert, ist noch lange kein Agent, der in einer fremden Welt selbstständig stabile Regeln entdeckt, falsche Theorien verwirft und sein Verhalten effizient anpasst.

Gleichzeitig wäre es unfair, aus den offiziellen ARC-AGI-3-Scores ein hartes Limit für LLM-basierte Systeme abzuleiten. Denn die offiziellen Tests verzichten bewusst auf genau die Komponenten, die heutige Agentensysteme in der Praxis leistungsfähiger machen: Tools, Speicher, strukturierte Wahrnehmung, Suchverfahren, Reflexion und Kontextmanagement.

Die für mich spannendste nächste Messung wäre deshalb ein eingefrorenes, nicht ARC-spezifisches Agenten-Harness auf privaten ARC-AGI-3-Umgebungen.

Nicht: Wie gut kann ein Mensch ARC-AGI-3 für ein Modell lösen?

Sondern: Wie gut kann ein generisches KI-Agentensystem neue Regeln entdecken, wenn es dieselben Werkzeuge nutzen darf, die wir auch in echten Anwendungen brauchen?

AFAIK: Genau dort wird es interessant. Nicht beim nächsten Prozentpunkt auf einem Leaderboard, sondern bei der Frage, ob wir aus starken Sprachmodellen robuste, adaptive Handlungssysteme bauen können – ohne jedes neue Problem vorher für sie zu präparieren.

Abonniere das AFAIK-Update

Bleib auf dem Laufenden in Sachen Künstliche Intelligenz im Online Marketing!

Melde Dich jetzt mit Deiner E-Mail-Adresse an und ich versorge Dich kostenlos mit News-Updates, Tools, Tipps und Empfehlungen Rund um KI aus den Bereichen Online-Marketing, SEO, GEO, WordPress und vieles mehr.

Keine Sorge, ich mag Spam genauso wenig wie Du und gebe Deine Daten niemals weiter! Du bekommst höchstens einmal pro Monat eine E-Mail von mir. Versprochen.