Wenn Google-Mitarbeiter:innen einen ganzen Tag lang vor einem Publikum aus SEOs stehen, lohnt es sich, sehr genau zuzuhören. Am 21. April 2026 war es wieder so weit: In Toronto fand das erste Google Search Central Live auf kanadischem Boden statt. Fünf Vorträge, ein Panel, viele Folien – und am Ende eine ziemlich klare Botschaft: KI verändert die Suche, aber sie macht das klassische SEO-Handwerk nicht überflüssig. Sie erhöht eher die Messlatte.

Der kanadische SEO Jean-Christophe Chouinard war vor Ort, hat die Slides fotografiert und sie in seinem Blog dokumentiert. Auf Basis dieser Dokumentation ordne ich hier die wichtigsten Aussagen der fünf Sessions ein – und leite daraus ab, was für die tägliche SEO-Arbeit relevant ist.

Die Vortragenden:

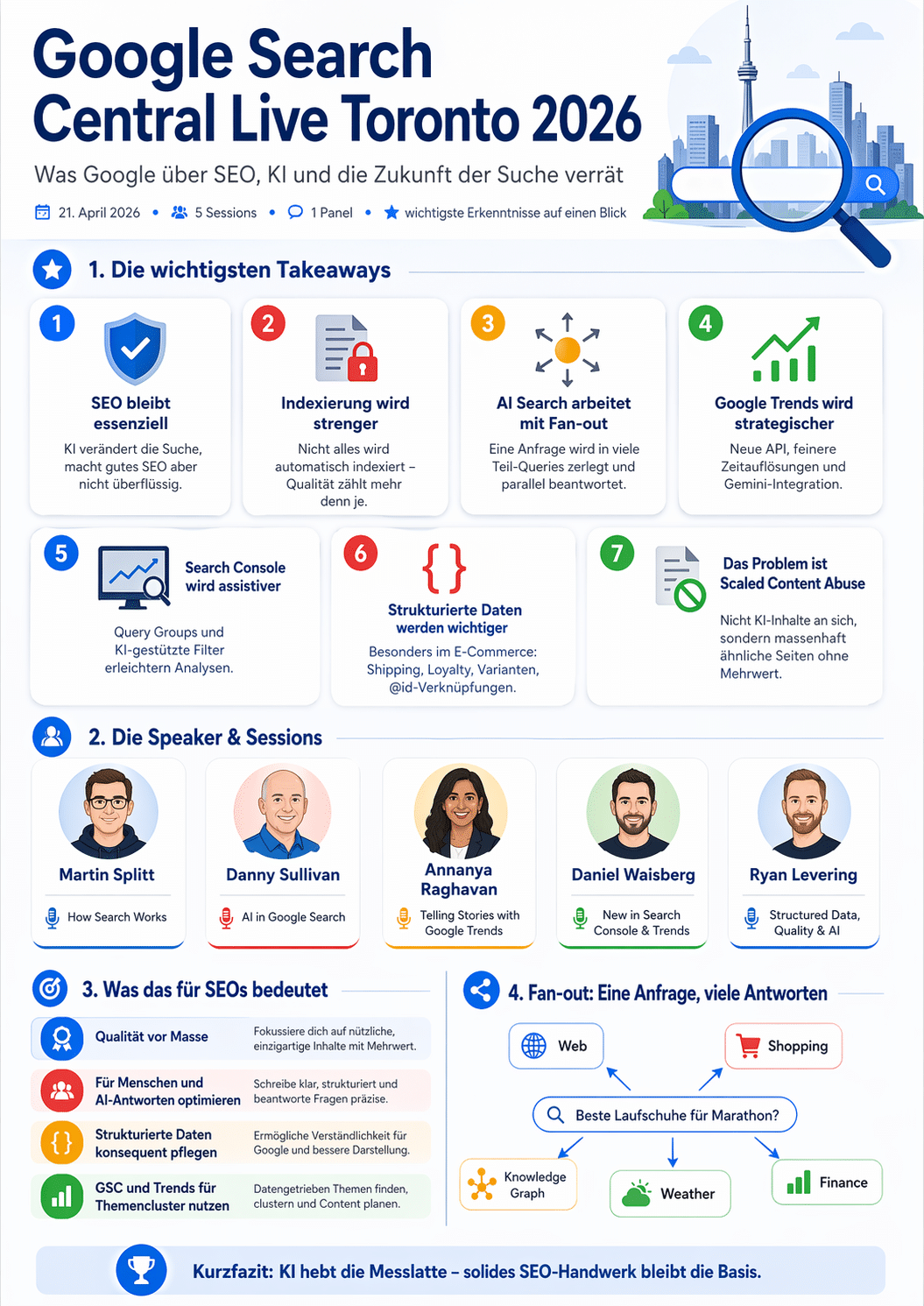

- Martin Splitt (Search Advocate) – „How Search Works“

- Danny Sullivan (Director, Google Search) – „AI in Google Search“

- Annanya Raghavan (Trends Analyst) – „Telling Stories with Google Trends“

- Daniel Waisberg (Search Advocate) – „New in Search Console & Trends“

- Ryan Levering (Search Engineering) – „Structured Data, Quality & AI“

Die wichtigsten Takeaways auf einen Blick

Bevor wir in die einzelnen Sessions einsteigen, die verdichtete Version für alle, die es eilig haben:

- Indexierung ist kein Selbstläufer mehr. Weil KI Content-Produktion trivialisiert hat, hebt Google die Qualitätsschwelle dafür an, was überhaupt indexiert wird. „Crawled – currently not indexed“ ist selten ein Rendering-Problem.

- Gutes SEO ist gutes „GEO“. Die neuen Akronyme (GEO, AEO, LLM SEO, AI SEO) ändern wenig an den Grundlagen. Für AI Overviews und AI Mode gelten dieselben Prinzipien wie für die klassische Suche.

- Fan-out ist der Schlüssel, um AI Search zu verstehen. Eine einzelne Query wird in viele Teil-Queries zerlegt, die parallel Quellen aus Web, Shopping, Knowledge Graph, Wetter und Finance einsammeln.

- Google Trends wird erwachsen. Eine neue API (Alpha), konsistente Skalierung, neue Zeitauflösungen und Gemini-Integration machen Trends vom Keyword-Tool zum Narrativ-Werkzeug.

- Search Console wird assistiver. Query Groups bündeln ähnliche Anfragen, eine AI-powered Configuration übersetzt natürliche Sprache in Filter – GSC-Analysen sollen zugänglicher werden.

- Strukturierte Daten sind nicht tot – sie werden wichtiger. Vor allem im E-Commerce: Shipping, Loyalty, Produktvarianten, Cross-Page-

@id-Verknüpfungen. - KI-generierter Content ist nicht per se das Problem. Das Problem heißt Scaled Content Abuse: massenhaft ähnliche Seiten ohne Mehrwert.

Jetzt im Detail.

1. Martin Splitt: How Search Works

Martin Splitt hatte den undankbaren, aber wichtigen Job des Grundlagen-Vortrags. Seine Folien waren eine Erinnerung daran, dass viele SEO-Fragen leichter werden, wenn man das Modell dahinter wirklich verstanden hat.

Das Life-of-a-URL-Modell

Splitt zerlegte den Weg einer URL in vier Zustände:

- Discovered – Google weiß, dass die URL existiert (über Links oder Sitemap).

- Crawled – Googlebot hat die URL abgerufen.

- Indexed – die URL wurde verarbeitet und in den Index aufgenommen.

- Serving – die URL erscheint in den Ergebnissen, wenn sie für eine Query ein guter Kandidat ist.

Der Punkt: Jeder dieser Schritte kann scheitern. URLs sind schwer zu entdecken, Crawling dauert oder wird durch robots.txt verhindert, Indexing kann eine andere Canonical-URL wählen, URLs können wieder aus dem Index fallen, andere URLs können für dieselbe Query bessere Kandidaten sein – und die Suchnachfrage selbst verändert sich.

Das mündet in einen Satz, der auf einer eigenen Folie prangte: „Google won’t index everything at all times.“ Das ist kein Bug, das ist Feature. Und es ist die Grundlage für den nächsten wichtigen Gedanken.

Unterschiedliche Signale für unterschiedliche Inhalte

Google nutzt hunderte Signale, aber nicht für alles dieselben. Splitt zeigte:

- Webseiten: Text, Links, Passagen

- Bilder: Auflösung, Farbe, umliegender Text

- News: Frische, Originalität, Diversität

- Local: Standort, Typ, Bewertung, Öffnungszeiten

- Videos: Sprache, Transkripte

Für SEO heißt das: Wer auf Image Search zielt, optimiert anders als für News oder lokale Suche. Eine vertikalübergreifende Einheits-SEO-Checkliste gibt es nicht.

Search ist ein Experimentiersystem

Eine Zahl aus der Session, die hängenbleibt: 719.000 Search-Quality-Tests und mehr als 4.700 Launches allein im Jahr 2023. Wer also denkt, zwischen zwei Core Updates sei „nichts los“, irrt – es ist eher so, dass laufend Kleinigkeiten angepasst werden, die in Summe sichtbar werden.

2. Danny Sullivan: AI in Google Search

Danny Sullivan hatte die Aufgabe, das Thema zu besprechen, das alle umtreibt: AI Overviews, AI Mode, Fan-outs, Agentic Search. Seine Kernbotschaft war zugleich beruhigend und unbequem.

„Good SEO is good GEO“

Sullivan fasste eine Folie mit den Akronymen GEO, LLM SEO, AEO – und einem ironischen „Let’s go back to the basics“ – in einem Satz zusammen, der in den kommenden Monaten noch oft zitiert werden dürfte: Gute SEO ist gute „GEO“ (oder AEO, oder AI SEO, oder LLMNOPEO). Die Suchoberfläche ändert sich, die zugrunde liegenden Qualitätsprinzipien nicht.

Wie Fan-out wirklich funktioniert

Sullivan erklärte AI Search als Kombination aus drei Informationsquellen:

- Allgemeines Modellwissen aus dem Training.

- Spezifisches Wissen aus klassischen Suchergebnissen.

- Fan-out – die ursprüngliche Query wird in verwandte Sub-Queries zerlegt.

Das Beispiel aus den Folien: Aus „ebikes in red for 5 mile commute with hills“ werden intern Queries wie „best ebikes“, „ebikes for hills“ und „red ebikes“. Diese Sub-Queries ziehen parallel Informationen aus unterschiedlichen Vertikalen: Shopping, Knowledge Graph, Real World, Web, Sport, Weather, Finance.

Die praktische Konsequenz: Sichtbarkeit in AI Search entsteht nicht nur über eine optimierte Haupt-Query. Man muss in all den Teilfragen präsent sein, die eine komplexe Nutzerfrage implizit enthält.

Commodity vs. Non-Commodity Content

Die vielleicht pragmatischste Folie der ganzen Veranstaltung war Sullivans Gegenüberstellung von austauschbarem und nicht-austauschbarem Content. Drei Beispiele aus seiner Präsentation:

- Laufschuh-Händler: „Top 10 Dinge beim Kauf von Laufschuhen“ (Commodity) vs. eine Analyse, warum die Schuhe eines konkreten Kunden nach 400 Meilen kollabiert sind, inklusive Laufmuster (Non-Commodity).

- Immobilienmakler: generische Erstkäufer-Tipps (Commodity) vs. ein konkreter Fall, in dem eine übersprungene Inspektion 15.000 Dollar gespart hat, mit Blick in die Abwasserleitung (Non-Commodity).

- Innenarchitektin: generische Küchentrends mit Pinterest-Bildern (Commodity) vs. ein Experiment, warum Marmor für eine fünfköpfige Familie ungeeignet war – mit Fleckentests von Traubensaft und Kurkuma (Non-Commodity).

Was guten Non-Commodity-Content auszeichnet: Unique, Specific, Authentic. Eigene Perspektive. Konkreter Fall. First-Hand-Erfahrung. Das ist genau der Content, den ein LLM nicht synthetisieren kann, weil er schlicht noch nicht im Trainingsdatensatz existiert.

Mythbusting: Was ihr NICHT tun müsst

Sullivan machte auf mehreren Folien mit typischen Missverständnissen auf:

- Kein „Chunking“ für KI. Baut euren Content für menschliche Leser:innen auf, nicht für hypothetische LLM-Parser.

- H1/H2-Header müssen nicht KI-präzise sein. Sie sind für Menschen da.

- Keine „Conversational Keywords“ auf Vorrat. Googles Sprachverständnis erkennt Synonyme und Beziehungen.

- JavaScript ist okay, solange Google es wie ein Mensch ausführen kann.

- Keine Website nach Markdown migrieren. Laut Notizen kein SEO- oder LLM-Vorteil.

- Keine

llms.txtanlegen. Laut Notizen ebenfalls kein SEO-Nutzen.

Und zum Dauerbrenner KI-Content: Generative KI ist für Recherche und Strukturierung in Ordnung. Problematisch wird es bei Scaled Content Abuse – massenhaft publizierte Seiten ohne eigenen Mehrwert. Googles Spam Policies zielen genau darauf, nicht auf KI als Werkzeug an sich.

Agentic Search – vor allem Commerce

Ein spannender, aber klar begrenzter Teil war der Ausblick auf agentische Features:

- Business Agent: Händler:innen in den USA können im Merchant Center einen gebrandeten Agent aktivieren, mit dem Käufer:innen direkt in Google Search chatten können.

- Universal Commerce Protocol (UCP): Soll eine neue Checkout-Funktion in AI Mode und der Gemini-App antreiben.

Die ehrliche Einordnung aus den Notizen: Jenseits von Commerce und UCP waren nicht viele konkrete neue Chancen sichtbar. Wer also kein E-Commerce-Business betreibt, darf Agentic Search vorerst beobachten statt hyperventilieren.

Messen, nicht zählen

Sullivan wies darauf hin, dass Nutzer:innen, die aus AI Overviews auf eine Seite klicken, tendenziell länger bleiben und engagierter sind – weil sie bereits kontextuell vorgewärmt sind. Die Messlatte darf also nicht nur das Klickvolumen sein. Wichtiger werden Besuchsdauer, Signups, Conversions, Engagement und qualitative Signale.

3. Annanya Raghavan: Storytelling mit Google Trends

Annanya Raghavans Vortrag war die strategisch vielleicht inspirierendste Session. Ihre These: Trends ist kein Keyword-Tool. Trends ist ein kultureller Kompass.

„Why Narratives Beat Keywords“

Raghavans Leitsatz: Keywords zeigen, was Menschen wollen. Trends zeigen, wer Menschen sind. Ein Keyword ist eine Transaktion, ein Trend eine Transformation im Publikumsverhalten.

Was Trends-Daten laut ihrer Darstellung einzigartig macht:

- Big: Milliarden Suchanfragen pro Tag – einer der größten Echtzeit-Datensätze der Welt.

- Immediate: nahezu in Echtzeit, was Menschen gerade umtreibt.

Ein paar Beispiele, die in der Session hängen geblieben sind:

- Globale Frage „how can we control anxiety“

- Kanada: „how can we reduce food waste“

- Indien: „how can we care for our elders“

- UK: „how can we mitigate climate change“

- USA: „how can we stop bullying“

Dieselbe Satzstruktur – und doch völlig unterschiedliche gesellschaftliche Prioritäten.

Tagesrhythmen und Kulturmuster

Raghavan zeigte tägliche Peaks verschiedener Suchanfragen:

- 7:00 Uhr – „surfing“ in Australien

- 8:00 Uhr – „full english“ in England

- 13:00 Uhr – „beer garden“ in Deutschland

- 15:00 Uhr – „hiking“ in Kanada

- 16:00 Uhr – „disco“ in Spanien

- 17:00 Uhr – „karaoke“ in Japan

- 23:00 Uhr – „jazz music“ in Brasilien

Für Content-Planung, Paid-Timing oder regionale Ansprache ist das Gold wert – solange man Trends konsequent dafür nutzt.

Die drei Säulen narrativer Verbindung

Raghavans Framework für strategische Trends-Nutzung:

- Seasonality vs. Spontaneity – erwartbare jährliche Peaks planen, aber agil genug für Breakout-Momente bleiben.

- Generative Context – Search-AI-Features analysieren, um zu verstehen, wie Informationen synthetisiert werden.

- The Narrative Gap – Breakout-Trends gegenüber statischen High-Volume-Keywords priorisieren, um First-Mover-Vorteile in AI-Antworten zu sichern.

Der Brand-Connectivity-Prozess in fünf Schritten

- Identify: In Trends eine Breakout-Query finden, bei der Neugier schneller steigt als der Wettbewerb.

- Verify: Über „Interest by Subregion“ regionale Relevanz gegenprüfen.

- Synthesize: In Search AI prüfen, wie Google das Thema aktuell zusammenfasst.

- Differentiate: Eigene Daten, Expertise oder Perspektive hinzufügen, die über den AI-Gist hinausgeht.

- Execute: Hilfreichen, originären Content veröffentlichen, der das tiefere „Warum“ beantwortet.

Das ist im Grunde ein SEO-Prozess, in den AI Search als Research-Tool integriert wird – nicht als Bedrohung, sondern als Diagnoseinstrument.

4. Daniel Waisberg: Neues in Search Console und Trends

Daniel Waisberg brachte die konkreten Tool-News mit. Vier Themen: Query Groups, AI-powered Configuration, Trends API (Alpha), Trends Explore mit Gemini.

Query Groups: Weil eine Anfrage hundert Varianten hat

Waisberg nutzte das wunderbare Beispiel „How to spell Britney Spears?“ – mit einer langen Liste der Schreibweisen, die Menschen tatsächlich eintippen. Genau dieses Problem adressieren Query Groups: ähnliche Anfragen werden automatisch zu Themenclustern gebündelt.

Beispiele aus der Insight Card in den Folien: schema checker, seo, robots.txt, core web vitals, google core update. Jede Gruppe kommt mit Gesamtmetriken, Top Countries und Additional Traffic Sources – und lässt sich auf die zugrunde liegende Regex drill-downen. Wer will, kann die Gruppierung also bis auf Einzelquery-Ebene nachvollziehen.

Query Groups lösen ein echtes Problem: Statt sich durch hundert Keyword-Varianten zu filtern, bekommt man Themen serviert. Pluspunkt für Dashboards und Executive Reports.

AI-powered Configuration: GSC per Prompt

Die zweite Neuerung ist eine experimentelle Funktion, die natürliche Sprache in GSC-Filter übersetzt. Drei Schritte:

- Wunsch in Umgangssprache beschreiben.

- System schlägt passende Filter und Einstellungen vor.

- Prüfen, anwenden (oder verwerfen).

Beispielprompt aus der Demo: „CTR von Queries anzeigen, die ‚how to‘ oder ‚what is‘ enthalten, in Kanada letzte Woche.“ Die vorgeschlagene Konfiguration: letzte 7 Tage, Web-Search, Country Canada, Query-Matching how to | what is, Metric CTR, Breakdown Queries.

Wichtig: Es gibt einen expliziten Review-Schritt. Die KI schlägt vor, Menschen entscheiden. Das Feature ist als experimentell markiert – Feedback ausdrücklich erwünscht.

Trends API (Alpha)

Für alle, die bisher mit Screenshots aus dem Trends-UI leben mussten: Es kommt eine echte API. Die relevanten Eckdaten:

- 5 Jahre Rolling Window, Daten bis 48 Stunden vor „jetzt“ (die Verzögerung ist bewusst, um Missbrauch zu erschweren).

- Konsistent skalierte Suchinteresse-Werte – isolierte Einzelabfragen sind damit mit Vergleichsabfragen kompatibel (das war vorher ein häufiger Stolperstein).

- Neue Zeitauflösungen: täglich, wöchentlich, monatlich, jährlich.

- Asynchrones Request-Modell: Anfrage erstellen, Operation-ID erhalten, Ergebnis abrufen.

Ein Sample-Request aus der Folie: geo: US, expression: "world cup", time_range: 2024-01-01 bis 2024-12-31, time_resolution: WEEK. Die Response liefert points mit search_interest und scaled_search_interest.

Das ist ein ziemlich großer Schritt für alle, die Trends-Daten in Dashboards, Data-Science-Workflows oder Content-Planungs-Tools einbinden wollen.

Trends Explore mit Gemini

Die vierte Neuerung: Ein Gemini-gestütztes Panel in Trends Explore, das Themenvorschläge macht. Beispiel aus den Folien: Für die Eingabe „Dog breeds“ schlägt Gemini Verfeinerungen wie „small dog breeds“, „hypoallergenic dog breeds“, „Labrador vs. Golden Retriever“ oder „most popular dog breeds in the US“ vor.

Nützlich für Brainstorming – und um nicht ständig im eigenen Bubble-Vokabular festzustecken.

5. Ryan Levering: Strukturierte Daten, Qualität & KI

Ryan Leverings Vortrag war die technische Kür – und die wichtigste Korrektur an einem verbreiteten Mythos: Strukturierte Daten sind in der KI-Ära nicht weniger wichtig, sondern mehr.

Die zwei Extrempositionen – und die Wahrheit dazwischen

Levering stellte zwei überzogene Sichtweisen gegenüber:

- „Strukturierte Daten sind nutzlos, LLMs verstehen auch ohne Schema alles.“

- „Strukturierte Daten sind die Zukunft, Agenten brauchen eh kein Web mehr.“

Beides falsch. Seine vier Argumente, warum strukturierte Daten weiter wichtig sind:

- Precision: Für komplexe Commerce-Schemata (z. B. Sale Pricing) sind sie präziser als LLM-Extraktion.

- Extra Content: Sie transportieren unsichtbare Metadaten (vollständige ISO-Daten, stabile IDs), die im sichtbaren Text fehlen.

- Efficiency: Parsebare Daten sind deutlich günstiger als LLM-Extraktion bei jedem Crawl.

- Focus: Sie heben die relevanten Datenpunkte hervor und verhindern, dass das System irrelevante Informationen (z. B. Preise verwandter Produkte) heranzieht.

Entscheidend: Strukturierte Daten befeuern nicht nur Rich Results in der SERP. Sie werden auch als Kontext in AI Overviews und AI Mode verwendet.

Der Shopping-Schwerpunkt

Der Großteil der Session drehte sich um E-Commerce. Die wichtigen Bausteine:

Shipping Service Annotations

handlingTimealsServicePeriodmitcutoffTimeundduration.shippingConditionsmit Destinations, Mindestbestellwerten, Raten.- Konkrete Beispiele: Versand bis 14:30 Uhr, 30 Minuten Handling, kostenloser Versand nach FR und DE ab 50 Euro Bestellwert.

Loyalty Programs

- Organization → MemberProgram → MemberProgramTier → Benefit (z. B. Member Price, kostenloser Versand).

- Tiers bekommen stabile

@id-URLs, auf die andere Dokumente verlinken können.

Cross-Page-Verknüpfung über @id

- Versandangebote können per

validForMemberTierauf den entsprechenden Loyalty-Tier verweisen. - Produkte können auf Organisationsrichtlinien verlinken.

Und der Ausblick: Google will die Symmetrie zwischen Merchant-Center-Feeds und Web-Markup stärken – was bedeutet, dass saubere Structured Data auf der Website zunehmend dieselben Signale liefert wie gepflegte Feeds.

Rich Results Test vs. schema.org Validator

Eine praktische Klarstellung aus der Session: Diese beiden Tools beantworten unterschiedliche Fragen.

- Rich Results Test (

search.google.com/test/rich-results): Nutzt Googles internen Indexing-Stack und prüft, ob Google das Markup tatsächlich verarbeiten kann. - schema.org Validator (

validator.schema.org): Prüft reine Standardkonformität – unabhängig davon, ob Google etwas damit anfangen würde.

Für SEO-Zwecke ist der Rich Results Test der relevantere Check. Der schema.org Validator ist für strikte Standardvalidierung gedacht.

UGC, Forum und Q&A

Kleine, aber feine Neuerungen:

- Bessere Verarbeitung von Embedded Posts und Reposts.

- Ein neues Property

digitalSourceType, das maschinengenerierte Inhalte kennzeichnen kann (algorithmisch vs. modellgeneriert).

Und für Bildauswahl in Search/AI: primaryImageOfPage, mainEntity -> image und og:image sind die Signale, auf die Google hört.

Praktische Implikationen für SEO

Wer die fünf Sessions zusammennimmt, bekommt eine erstaunlich kohärente To-do-Liste für die nächsten Monate.

Indexierung und Crawling

„Crawled – currently not indexed“ ist selten ein Rendering-Problem. Wer dieses Problem hat, sollte nicht zuerst ins JavaScript-Rendering schauen, sondern in Qualität, Duplicate Content, Canonicals, Nachfrage, Konkurrenz anderer URLs, 404s, Weiterleitungen und robots.txt. Sitemaps und interne Verlinkung bleiben wichtig, weil Discovery ein eigener Schritt im Life-of-a-URL-Modell ist.

Content-Strategie

- Nicht in Panik verfallen und die Website für AI Search umstrukturieren.

- Kein „Chunking“, keine Markdown-Migration, keine

llms.txt. - Dafür: Unique, Specific, Authentic. Eigene Daten, Experimente, Fälle, Perspektiven.

- Keine massenhaft ähnlichen KI-generierten Seiten – das ist Scaled Content Abuse.

Messung

AI-Search-Klicks nicht nur am Volumen bewerten. Engagement, Besuchsdauer, Conversions, Signups und qualitative Signale werden wichtiger. GSC Query Groups und AI-powered Configuration können Analyseaufwand reduzieren – aber vorgeschlagene Filter immer gegenprüfen.

Google Trends als strategisches Werkzeug

Trends ist mehr als ein Keyword-Research-Tool. Breakout-Themen können strategisch wichtiger sein als statisch hohe Suchvolumina. Regionale Muster, Tagesrhythmen und Ereignis-Peaks fließen in Content-Planung ein. Die neue API öffnet die Tür für systematischere Trends-Analyse.

Strukturierte Daten

Vor allem im E-Commerce: Shipping-Policies, Loyalty-Programme, Produktvarianten, Member Pricing, UGC-Kennzeichnung. Cross-Page-Verknüpfungen über stabile @id-URLs werden wichtiger. Und: Der Rich Results Test beantwortet eine andere Frage als der schema.org Validator – beide haben ihre Daseinsberechtigung.

Blockieren von Google-Extended

Ein Detail, das in den Notizen auftaucht und das oft missverstanden wird: Das Blockieren von Google-Extended beeinflusst laut Veranstaltung nicht die Sichtbarkeit in AI Overviews oder AI Mode negativ, weil Google die Inhalte auch aus dem regulären Suchindex heranziehen kann. Wer konkrete Inhalte wirklich von der KI-Nutzung ausschließen will, muss eher mit data-nosnippet arbeiten – was allerdings auch klassische SEO-Snippets beschränkt. Das komplette Blockieren kann zudem dazu führen, dass die eigene Seite nicht mehr als Grounding- oder Link-Quelle in AI-Antworten erscheint.

Fazit: Mehr Evolution als Revolution

Die ehrlichste Zusammenfassung der Veranstaltung steht auf einer von Danny Sullivans Folien: „All this is good news!“ Menschen müssen ihre Websites nicht panisch für AI-Search-Erfolg auseinanderreißen.

Was wirklich passiert, ist subtiler – und anspruchsvoller:

- Die Qualitätsschwelle für Indexierung steigt, weil KI Content-Produktion trivialisiert.

- Sichtbarkeit wird über mehr Oberflächen verteilt: Web, Bilder, Videos, Shopping, Local, Fan-outs.

- Strukturierte Daten werden zum zuverlässigeren Signal gegenüber KI-Extraktion.

- Measurement verschiebt sich vom Klick zum Engagement.

- Google selbst baut seine Tools (GSC, Trends) assistiver und API-freundlicher aus.

Und quer über alle fünf Sessions zog sich dieselbe Botschaft: Wer heute guten, eigenen, spezifischen Content für Menschen macht, ist für AI Search richtig aufgestellt. Keine neuen Akronyme. Keine magischen Schalter. Nur: Handwerk, ehrlich gemacht.

Wer die Originalfolien sehen will, findet die komplette Bildsammlung im Blogpost von Jean-Christophe Chouinard.

Quelle: JC Chouinard, „Google Search Central Live Toronto Slides (April 2026)“, veröffentlicht am 22. April 2026. Analyse und Einordnung auf Basis der dort dokumentierten Slides.

Abonniere das AFAIK-Update

Bleib auf dem Laufenden in Sachen Künstliche Intelligenz im Online Marketing!

Melde Dich jetzt mit Deiner E-Mail-Adresse an und ich versorge Dich kostenlos mit News-Updates, Tools, Tipps und Empfehlungen Rund um KI aus den Bereichen Online-Marketing, SEO, GEO, WordPress und vieles mehr.

Keine Sorge, ich mag Spam genauso wenig wie Du und gebe Deine Daten niemals weiter! Du bekommst höchstens einmal pro Monat eine E-Mail von mir. Versprochen.